您现在的位置是:网站首页> C/C++

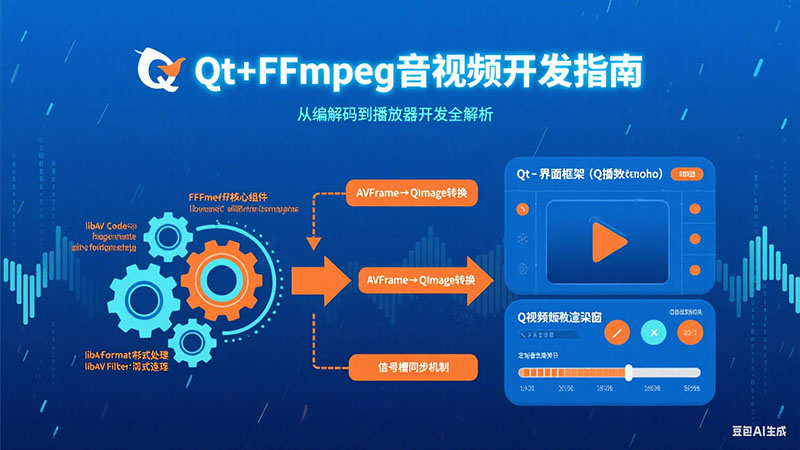

Qt与FFmpeg开发指南

- C/C++

- 2025-12-14

- 3140人已阅读

Qt与FFmpeg开发指南

善用AI辅助编程

ffmpeg Qt环境配置

1.使用QtCreator创建完项目后,在项目根目录下创建ffmpeglib文件夹

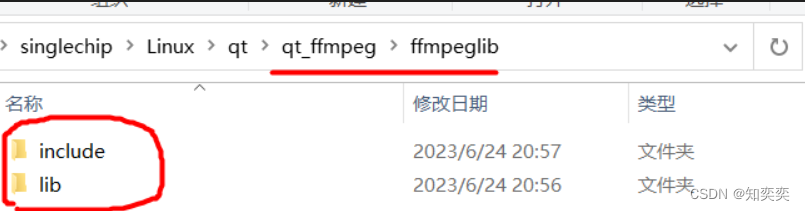

2、把下载好的include文件夹和lib文件夹拷贝到ffmpeglib文件夹中

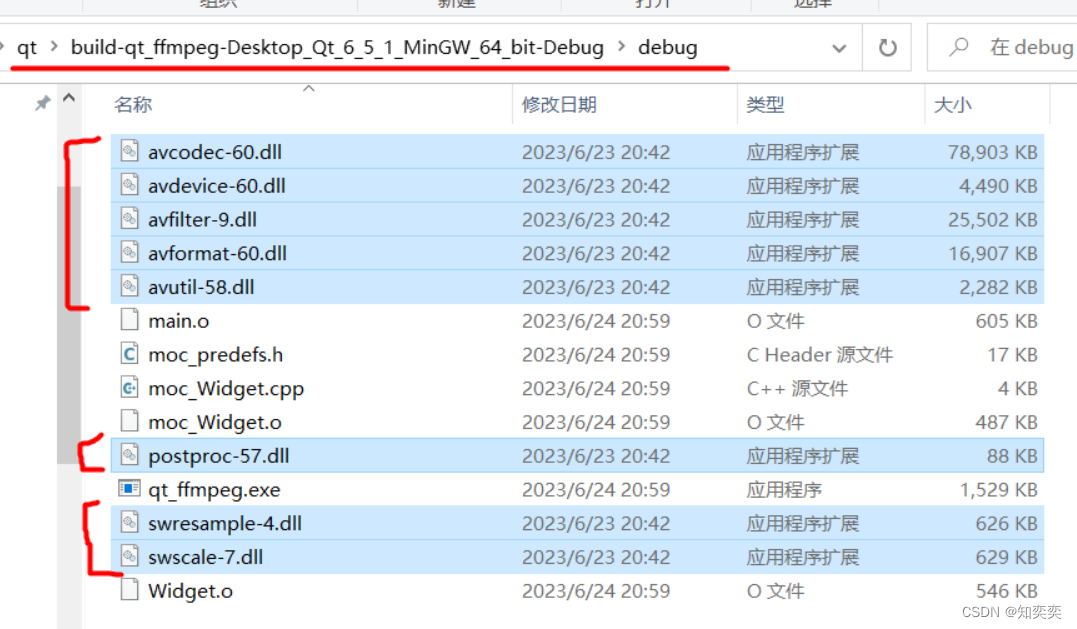

3、把dll文件夹中的所有.dll文件拷贝到项目根目录下的debug文件夹中(或项目根目录下也可以)

4、修改项目pro文件,在pro文件中增加如下内容:

INCLUDEPATH += $$PWD/ffmpeglib/include

#加入FFmpeg链接库

LIBS += $$PWD/ffmpeglib/lib/avcodec.lib \

$$PWD/ffmpeglib/lib/avdevice.lib \

$$PWD/ffmpeglib/lib/avfilter.lib \

$$PWD/ffmpeglib/lib/avformat.lib \

$$PWD/ffmpeglib/lib/avutil.lib \

$$PWD/ffmpeglib/lib/postproc.lib \

$$PWD/ffmpeglib/lib/swresample.lib \

$$PWD/ffmpeglib/lib/swscale.lib

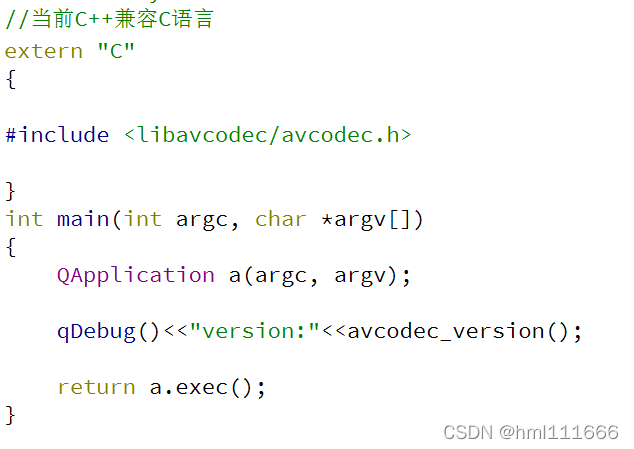

5、测试FFmpeg库是否引入且能正常使用

在项目中main.cpp中添加如下FFmpeg头文件

extern "C"

{

//avcodec:编解码(最重要的库)

#include <libavcodec/avcodec.h>

//avformat:封装格式处理

#include <libavformat/avformat.h>

//swscale:视频像素数据格式转换

#include <libswscale/swscale.h>

//avdevice:各种设备的输入输出

#include <libavdevice/avdevice.h>

//avutil:工具库(大部分库都需要这个库的支持)

#include <libavutil/avutil.h>

#include "libavutil/imgutils.h"

#include "libavutil/opt.h"

//SwrContext音频重采样使用

#include <libswresample/swresample.h>

}

在main.cpp中进行测试

qDebug()<<"version:"<<avcodec_version();

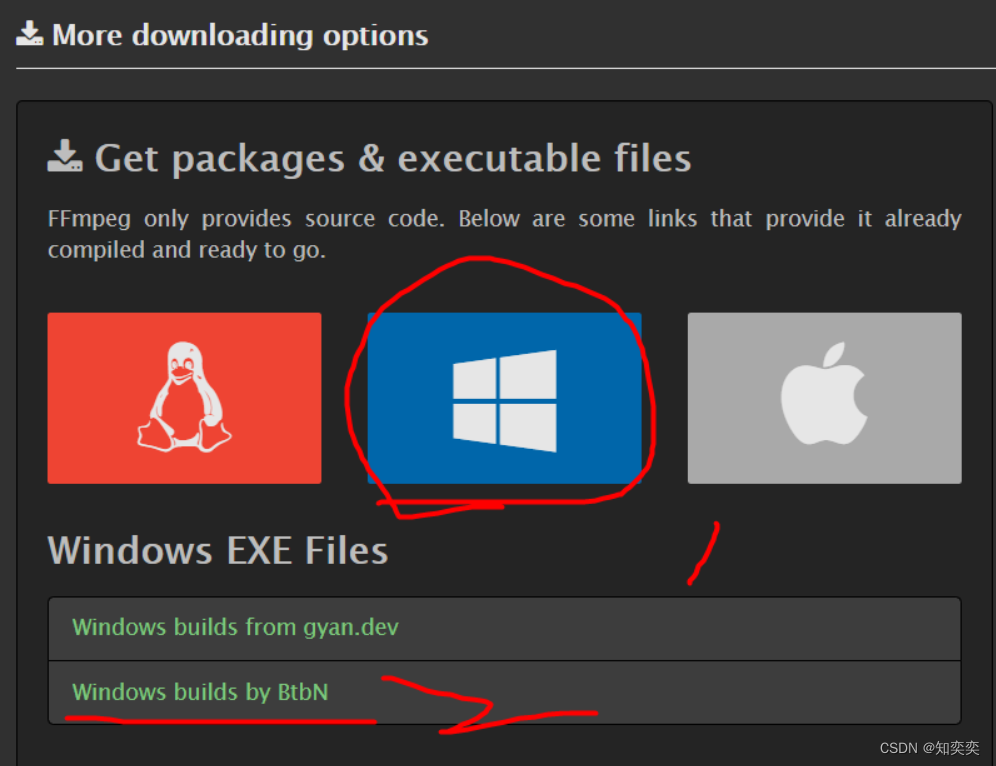

ffmpeg 下载

由于大部分的关于配置 ffmpeg+qt 环境的文章都停留在 2021 年,且许多方法均已过时,现在介绍一个最新的方法,并分析槽点供大家参考

前往 FFmpeg 官网下载对应库包:官网地址

按照下图,选择 window 版本的,推荐下载源选择图中指示的第二个

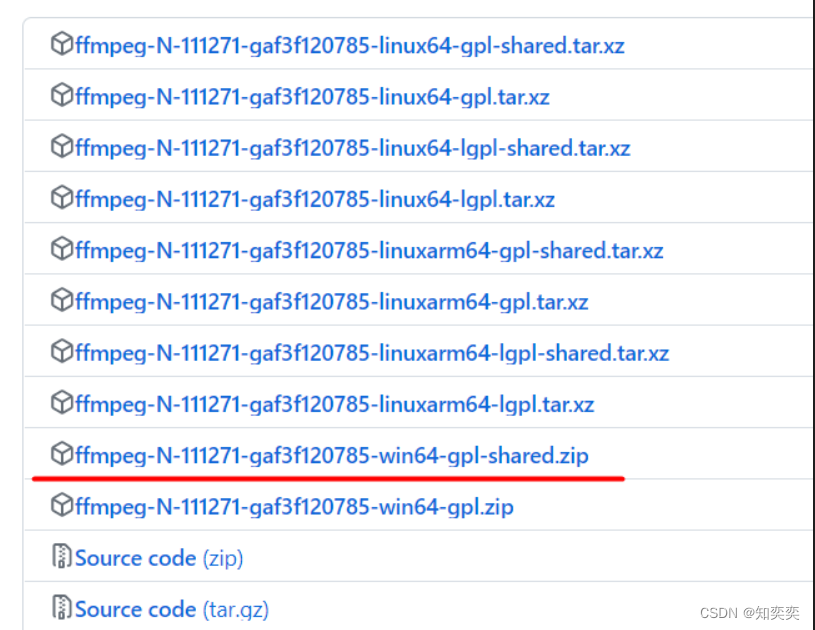

进入 github,下载带 shared 后缀的那个包即可

qt 配套环境配置

把下载好的压缩包解压到任意一个文件夹内,我们发现这里有 4 个文件夹

在项目根目录下新建一个文件夹 ffmpeglib

然后我们需要把 include 和 lib 这两个文件夹全部复制到该 ffmpeglib 目录下

最终看起来是这样的:(上方路径中,qt_ffmpeg 是我的项目根目录!)

这还没完,回到 qtcreator,打开咱们的项目,直接点击运行

此时会自动构建

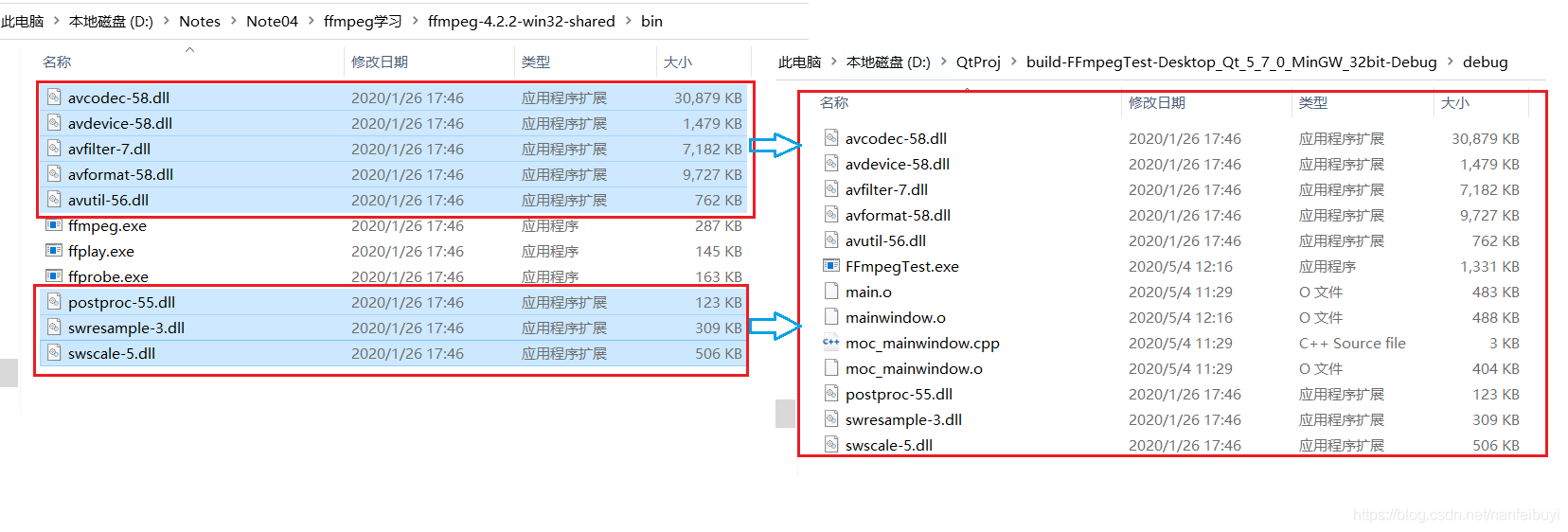

回到 ffmpeg 根目录下,打开 bin 目录,复制所有的 dll 文件,然后粘贴到构建文件夹的 debug 文件夹下

代码测试

在项目的 pro 文件内添加以下内容,导入项目根目录下的 ffmpeg 库

INCLUDEPATH +=$$PWD/ffmpeglib/include

LIBS += $$PWD/ffmpeglib/lib/avcodec.lib \

$$PWD/ffmpeglib/lib/avfilter.lib \

$$PWD/ffmpeglib/lib/avformat.lib \

$$PWD/ffmpeglib/lib/avutil.lib \

$$PWD/ffmpeglib/lib/postproc.lib \

$$PWD/ffmpeglib/lib/swresample.lib \

$$PWD/ffmpeglib/lib/swscale.lib

在 main.cpp 里面调用对应库,并使用一个简单的代码进行验证

#include "Widget.h"

#include <QApplication>

#include <QDebug>

// 需要使用C来对C++进行支持

// 注意注意注意,这里的C是大写的!不是小写的!小写会报错!

extern "C"

{

//avcodec:编解码(最重要的库)

#include <libavcodec/avcodec.h>

//avformat:封装格式处理

#include <libavformat/avformat.h>

//swscale:视频像素数据格式转换

#include <libswscale/swscale.h>

//avdevice:各种设备的输入输出

#include <libavdevice/avdevice.h>

//avutil:工具库(大部分库都需要这个库的支持)

#include <libavutil/avutil.h>

}

int main(int argc, char *argv[])

{

QApplication a(argc, argv);

Widget w;

w.show();

// 测试avcodec版本

qDebug() << avcodec_version();

return a.exec();

}

如果运行完全没有问题,你将会在应用程序输出里面看见一串数字

ffmpeg新旧函数对比

从FFmpeg 3.0 开始 , 使用了很多新接口,对不如下:

1. avcodec_decode_video2() 原本的解码函数被拆解为两个函数avcodec_send_packet()和avcodec_receive_frame() 具体用法如下:

old:

avcodec_decode_video2(pCodecCtx, pFrame, &got_picture, pPacket);

new:

avcodec_send_packet(pCodecCtx, pPacket);

avcodec_receive_frame(pCodecCtx, pFrame);

2. avcodec_encode_video2() 对应的编码函数也被拆分为两个函数avcodec_send_frame()和avcodec_receive_packet() 具体用法如下:

old:

avcodec_encode_video2(pCodecCtx, pPacket, pFrame, &got_picture);

new:

avcodec_send_frame(pCodecCtx, pFrame); avcodec_receive_packet(pCodecCtx, pPacket);

3. avpicture_get_size() 现在改为使用av_image_get_size() 具体用法如下:

old:

avpicture_get_size(AV_PIX_FMT_YUV420P, pCodecCtx->width, pCodecCtx->height);

new: //最后一个参数align这里是置1的,具体看情况是否需要置1

av_image_get_buffer_size(AV_PIX_FMT_YUV420P, pCodecCtx->width, pCodecCtx->height, 1);

4. avpicture_fill() 现在改为使用av_image_fill_arrays 具体用法如下:

old:

avpicture_fill((AVPicture *)pFrame, buffer, AV_PIX_FMT_YUV420P, pCodecCtx->width, pCodecCtx->height);

new: //最后一个参数align这里是置1的,具体看情况是否需要置1

av_image_fill_arrays(pFrame->data, pFrame->linesize, buffer, AV_PIX_FMT_YUV420P, pCodecCtx->width, pCodecCtx->height,1);

5. 关于codec问题有的可以直接改为codecpar,但有的时候这样这样是不对的,所以我也还在探索,这里记录一个对pCodecCtx和pCodec赋值方式的改变

old:

pCodecCtx = pFormatCtx->streams[video_index]->codec; pCodec = avcodec_find_decoder(pFormatCtx->streams[video_index]->codec->codec_id);

new:

pCodecCtx = avcodec_alloc_context3(NULL); avcodec_parameters_to_context(pCodecCtx,pFormatCtx->streams[video_index]->codecpar); pCodec = avcodec_find_decoder(pCodecCtx->codec_id);

6. PIX_FMT_YUV420P -> AV_PIX_FMT_YUV420P

7. 'AVStream::codec': 被声明为已否决:

old:

if(pFormatCtx->streams[i]->codec->codec_type==AVMEDIA_TYPE_VIDEO){

new:

if(pFormatCtx->streams[i]->codecpar->codec_type==AVMEDIA_TYPE_VIDEO){

8. 'AVStream::codec': 被声明为已否决:

old:

pCodecCtx = pFormatCtx->streams[videoindex]->codec;

new:

pCodecCtx = avcodec_alloc_context3(NULL); avcodec_parameters_to_context(pCodecCtx, pFormatCtx->streams[videoindex]->codecpar);

9. 'avpicture_get_size': 被声明为已否决:

old:

avpicture_get_size(AV_PIX_FMT_YUV420P, pCodecCtx->width, pCodecCtx->height)

new:

#include "libavutil/imgutils.h"

av_image_get_buffer_size(AV_PIX_FMT_YUV420P, pCodecCtx->width, pCodecCtx->height, 1)

10. 'avpicture_fill': 被声明为已否决:

old:

avpicture_fill((AVPicture *)pFrameYUV, out_buffer, AV_PIX_FMT_YUV420P, pCodecCtx->width, pCodecCtx->height);

new:

av_image_fill_arrays(pFrameYUV->data, pFrameYUV->linesize, out_buffer, AV_PIX_FMT_YUV420P, pCodecCtx->width, pCodecCtx->height, 1);

11. 'avcodec_decode_video2': 被声明为已否决:

old:

ret = avcodec_decode_video2(pCodecCtx, pFrame, &got_picture, packet); //got_picture_ptr Zero if no frame could be decompressed

new:

ret = avcodec_send_packet(pCodecCtx, packet);

got_picture = avcodec_receive_frame(pCodecCtx, pFrame); //got_picture = 0 success, a frame was returned //注意:got_picture含义相反

或者:

int ret = avcodec_send_packet(aCodecCtx, &pkt);

if (ret != 0)

{

prinitf("%s/n","error");

return;

} while( avcodec_receive_frame(aCodecCtx, &frame) == 0)

{

//读取到一帧音频或者视频 //处理解码后音视频 frame

}

12. 'av_free_packet': 被声明为已否决:

old:

av_free_packet(packet);

new:

av_packet_unref(packet);

13. avcodec_decode_audio4:被声明为已否决:

old:

result = avcodec_decode_audio4(dec_ctx, out_frame, &got_output, &enc_pkt);

new:

int ret = avcodec_send_packet(dec_ctx, &enc_pkt);

if (ret != 0)

{

prinitf("%s/n","error");

} while( avcodec_receive_frame(dec_ctx, &out_frame) == 0)

{

//读取到一帧音频或者视频

//处理解码后音视频 frame

}

旧接口av_register_all()------------新版不需要注册

PKT_FLAG_KEY ---------------->AV_PKT_FLAG_KEY

AV_CODEC_CAP_DELAY----->AV_CODEC_CAP_DELAY

guess_format ------------>av_guess_format

av_alloc_format_context ---------->avformat_alloc_output_context

CODEC_TYPE_VIDEO ----------------->AVMEDIA_TYPE_VIDEO

CODEC_TYPE_AUDIO ---------------->AVMEDIA_TYPE_AUDIO

audio_resample_init ----------------->av_audio_resample_init

PIX_FMT_YUV420P -> AV_PIX_FMT_YUV420P

AVStream::codec 被声明为已否决

'avpicture_get_size’: 被声明为已否决

新的API中将AVStream结构体中codec作了遗弃处理,当需要解码器上下文的时候,需要用AVCodecParameters去转化,解决方案是如下

av_free_packet(packet)--------------------> av_packet_unref(packet);

FFMPEG常用函数

FFMpeg 中比较重要的函数以及数据结构如下:

数据结构:

(1) AVFormatContext

(2) AVOutputFormat

(3) AVInputFormat

(4) AVCodecContext

(5) AVCodec

(6) AVFrame

(7) AVPacket

(8) AVPicture

(9) AVStream

初始化函数:

(1) av_register_all()

(2) avcodec_open()

(3) avcodec_close()

(4) av_open_input_file()

(5) av_find_input_format()

(6) av_find_stream_info()

(7) av_close_input_file()

音视频编解码函数:

(1) avcodec_find_decoder()

(2) avcodec_alloc_frame()

(3) avpicture_get_size()

(4) avpicture_fill()

(5) img_convert()

(6) avcodec_alloc_context()

(7) avcodec_decode_video()

(8) av_free_packet()

(9) av_free()

文件操作:

(1) avnew_steam()

(2) av_read_frame()

(3) av_write_frame()

(4) dump_format()

其他函数:

(1) avpicture_deinterlace()

(2) ImgReSampleContext()

QT+FFMPEG实现视频播放

开发环境:MinGW+QT5.9+FFMPEG20190212

一、开发环境搭建

FFMPEG的开发环境部署比如容易,在官网下载库文件,然后在QT里面指定路径,把相关dll文件放到exe目录下就可以了,不需要根据开发工具重新编译。

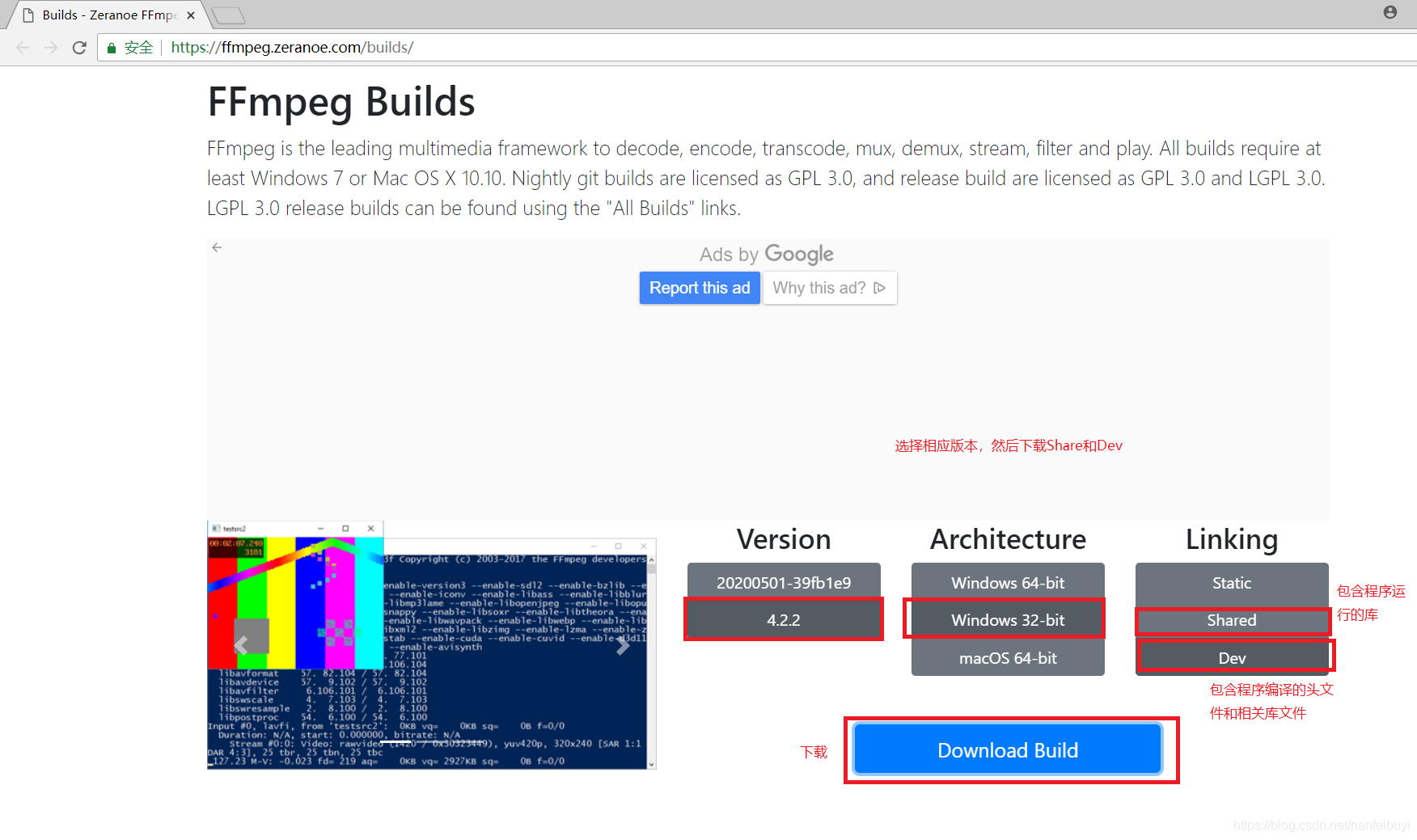

(1)下载工具

在https://ffmpeg.zeranoe.com/builds/下载对应版本。链接方式有三种,

Static:这个版本只包含了ffmpeg.exe、ffplay.exe、ffprobe.exe三个可执行程序,没有头文件和库文件。

Shared:这个版本包含了ffmpeg.exe、ffplay.exe、ffprobe.exe三个可执行程序和相关动态库文件。

Dev:开发版,这个包含了头文件和库文件。

我们需要下载Shared和Dev两个版本,Dev有我们程序开发需要的头文件和库文件,这里面包含的库是动态调用的,所依赖的动态库在Shared这个版本里面,所以两个版本都要下载。

(2)添加库

将下载的文件解压缩,然后新建一个QT工程,在pro添加lib目录和include目录的路径。

INCLUDEPATH +="E:\\Lib\\ffmpeg\\include"

LIBS += -LE:\Lib\ffmpeg\lib -lavutil -lavformat -lavcodec -lavdevice -lavfilter -lpostproc -lswresample -lswscale

然后将shared下的动态库添加到exe目录下。

二、代码实现播放功能

在界面上放置一个QLabel和QPushButton控件,当点击按钮时实现以下功能:

复制代码

#include <QTime>

extern "C"{

#include <libavcodec/avcodec.h>

#include <libavformat/avformat.h>

#include <libswscale/swscale.h>

#include <libavutil/imgutils.h>

}

void Delay(int msec)

{

QTime dieTime = QTime::currentTime().addMSecs(msec);

while( QTime::currentTime() < dieTime )

QCoreApplication::processEvents(QEventLoop::AllEvents, 100);

}

void MainWindow::on_btnPlay_clicked()

{

AVFormatContext *pFormatCtx;

int i, videoindex;

AVCodecContext *pCodecCtx;

AVCodec *pCodec;

AVFrame *pFrame, *pFrameRGB;

unsigned char *out_buffer;

AVPacket *packet;

int ret, got_picture;

struct SwsContext *img_convert_ctx;

char filepath[] = "E:\\media\\1.avi";

//初始化编解码库

av_register_all();//创建AVFormatContext对象,与码流相关的结构。

pFormatCtx = avformat_alloc_context();

//初始化pFormatCtx结构

if (avformat_open_input(&pFormatCtx, filepath, NULL, NULL) != 0){

printf("Couldn't open input stream.\n");

return ;

}

//获取音视频流数据信息

if (avformat_find_stream_info(pFormatCtx, NULL) < 0){

printf("Couldn't find stream information.\n");

return ;

}

videoindex = -1;

//nb_streams视音频流的个数,这里当查找到视频流时就中断了。

for (i = 0; i < pFormatCtx->nb_streams; i++)

if (pFormatCtx->streams[i]->codec->codec_type == AVMEDIA_TYPE_VIDEO){

videoindex = i;

break;

}

if (videoindex == -1){

printf("Didn't find a video stream.\n");

return ;

}

//获取视频流编码结构

pCodecCtx = pFormatCtx->streams[videoindex]->codec;

//查找解码器

pCodec = avcodec_find_decoder(pCodecCtx->codec_id);

if (pCodec == NULL){

printf("Codec not found.\n");

return ;

}

//用于初始化pCodecCtx结构

if (avcodec_open2(pCodecCtx, pCodec, NULL) < 0){

printf("Could not open codec.\n");

return ;

}

//创建帧结构,此函数仅分配基本结构空间,图像数据空间需通过av_malloc分配

pFrame = av_frame_alloc();

pFrameRGB = av_frame_alloc();

//创建动态内存,创建存储图像数据的空间

//av_image_get_buffer_size获取一帧图像需要的大小

out_buffer = (unsigned char *)av_malloc(av_image_get_buffer_size(AV_PIX_FMT_RGB32, pCodecCtx->width, pCodecCtx->height, 1));

av_image_fill_arrays(pFrameRGB->data, pFrameRGB->linesize, out_buffer,

AV_PIX_FMT_RGB32, pCodecCtx->width, pCodecCtx->height, 1);

packet = (AVPacket *)av_malloc(sizeof(AVPacket));

//Output Info-----------------------------

printf("--------------- File Information ----------------\n");

//此函数打印输入或输出的详细信息

av_dump_format(pFormatCtx, 0, filepath, 0);

printf("-------------------------------------------------\n");

//初始化img_convert_ctx结构

img_convert_ctx = sws_getContext(pCodecCtx->width, pCodecCtx->height, pCodecCtx->pix_fmt,

pCodecCtx->width, pCodecCtx->height, AV_PIX_FMT_RGB32, SWS_BICUBIC, NULL, NULL, NULL);

//av_read_frame读取一帧未解码的数据

while (av_read_frame(pFormatCtx, packet) >= 0){

//如果是视频数据

if (packet->stream_index == videoindex){

//解码一帧视频数据

ret = avcodec_decode_video2(pCodecCtx, pFrame, &got_picture, packet);

if (ret < 0){

printf("Decode Error.\n");

return ;

}

if (got_picture){

sws_scale(img_convert_ctx, (const unsigned char* const*)pFrame->data, pFrame->linesize, 0, pCodecCtx->height,

pFrameRGB->data, pFrameRGB->linesize);

QImage img((uchar*)pFrameRGB->data[0],pCodecCtx->width,pCodecCtx->height,QImage::Format_RGB32);

ui->label->setPixmap(QPixmap::fromImage(img));

Delay(40);

}

}

av_free_packet(packet);

}

sws_freeContext(img_convert_ctx);

av_frame_free(&pFrameRGB);

av_frame_free(&pFrame);

avcodec_close(pCodecCtx);

avformat_close_input(&pFormatCtx);

}

FFmpeg 简单的视频播放例子(Qt)

一、简述

记--直接在FFmpeg官网下载已经编译好的库(也可以自己用源码编译),并在Qt程序中引用并使用,例子知识简单的播放,待完善。

例子代码和FFmpeg相关库文件:https://lanzous.com/b0c8c02qb 密码:3wdn

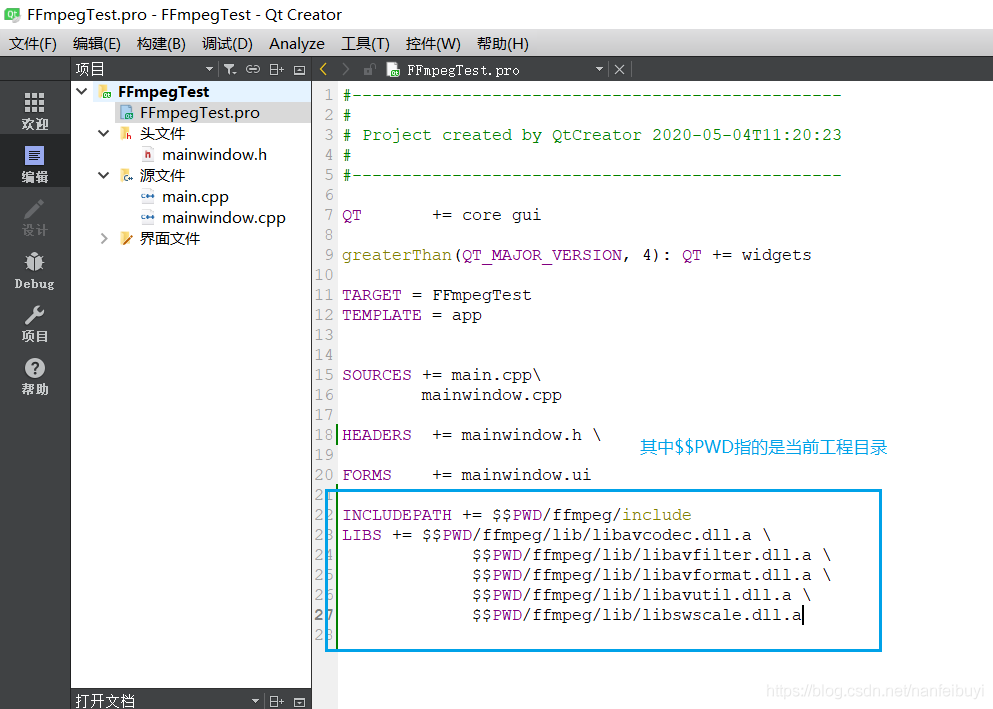

二、下载FFmpeg库(也可以自己用源码编译)

官网:https://ffmpeg.zeranoe.com/builds/

三、 在工程中引用FFmpeg

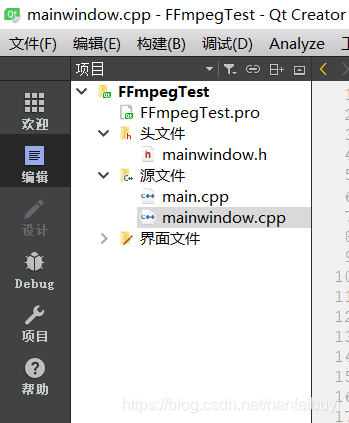

3.1 使用QtCreator创建一个“Qt Widgts Application”

3.2 将编译相关文件放到工程目录下

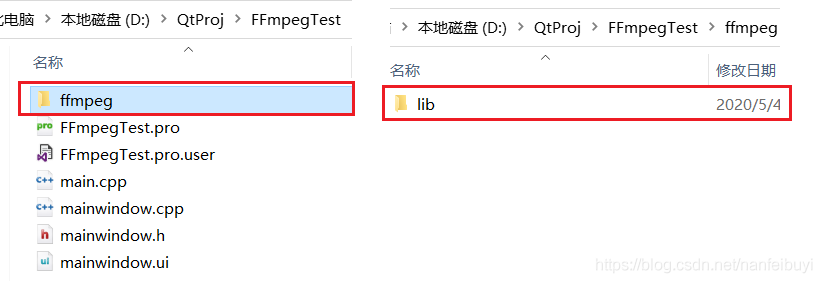

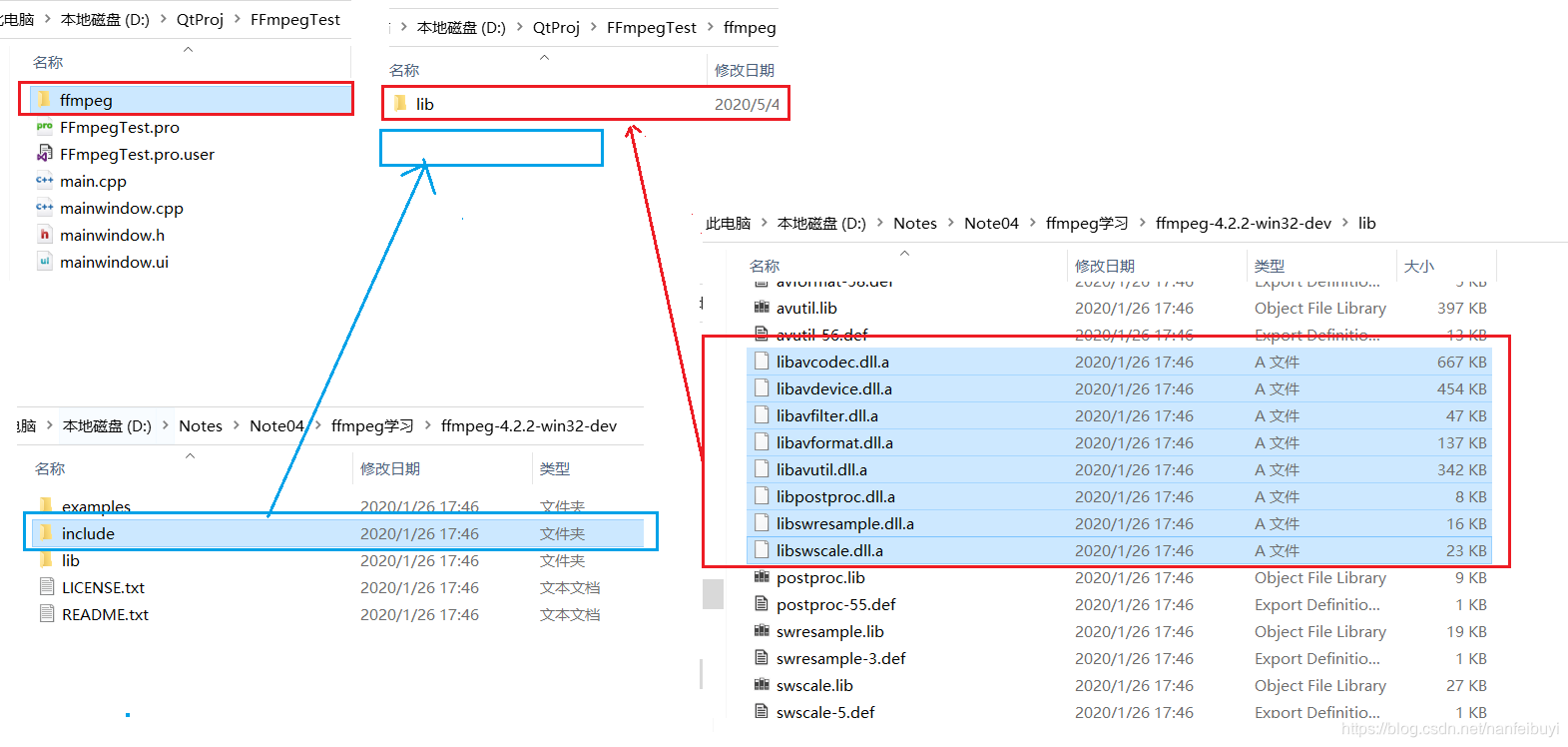

3.2.1 在工程目录下创建ffmpeg目录,以统一存放ffmpeg相关文件

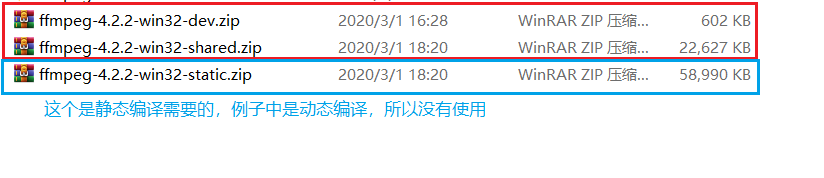

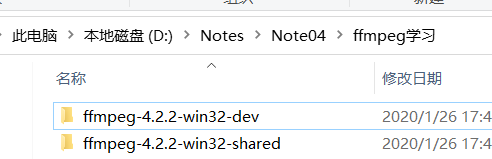

3.2.2 解压ffmpeg-4.2.2-win32-dev.zip和ffmpeg-4.2.2-win32-shared.zip

3.2.3 将相关文件拷贝到 3.2.1步骤创建的目录下

将ffmpeg-4.2.2-win32-dev目录下的include整个目录拷贝到ffmpeg目录下

将ffmpeg-4.2.2-win32-dev的lib目录下的所有.dll.a文件拷贝到ffmpeg/lib目录下

3.3 在项目中添加引用

3.3.1 在.pro文件添加头文件路径和lib路径

INCLUDEPATH += $$PWD/ffmpeg/include

LIBS += $$PWD/ffmpeg/lib/libavcodec.dll.a \

$$PWD/ffmpeg/lib/libavfilter.dll.a \

$$PWD/ffmpeg/lib/libavformat.dll.a \

$$PWD/ffmpeg/lib/libavutil.dll.a \

$$PWD/ffmpeg/lib/libswscale.dll.a

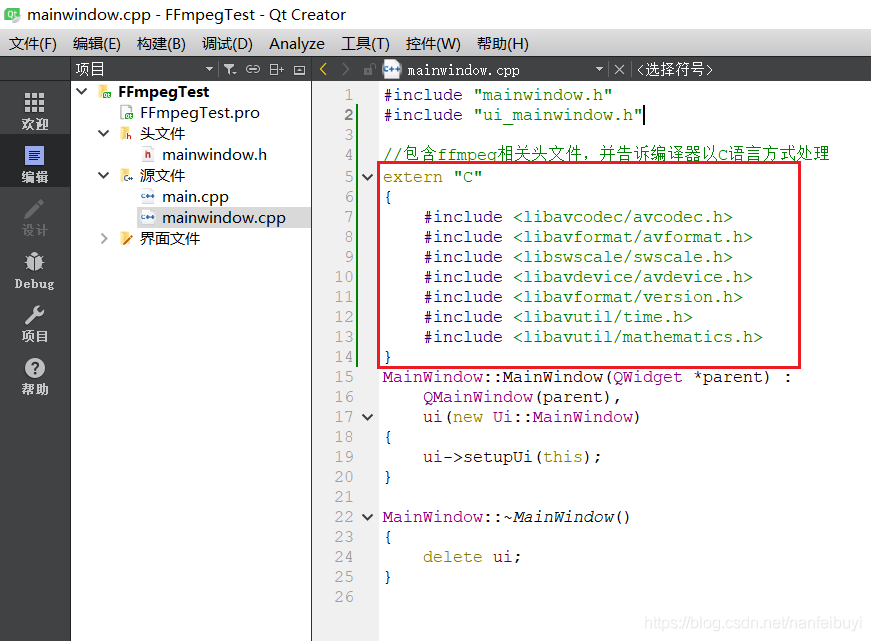

3.3.2 在代码中添加头文件引用

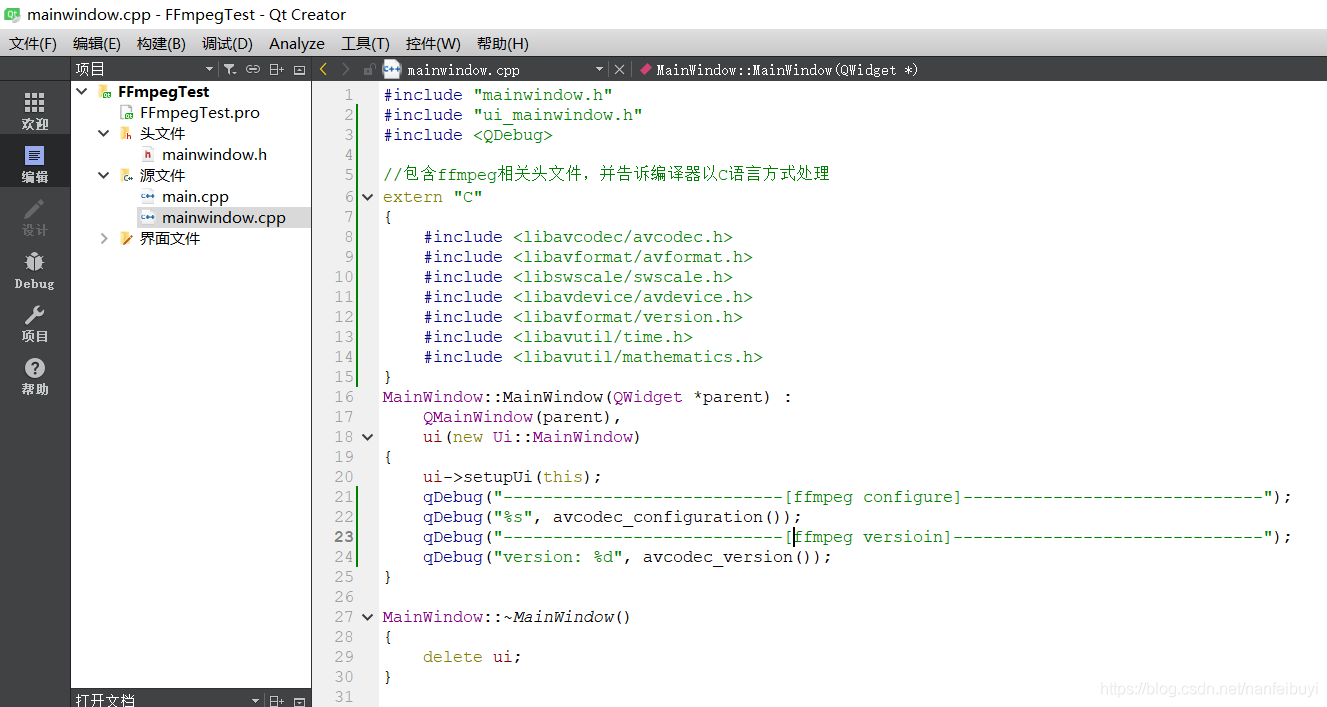

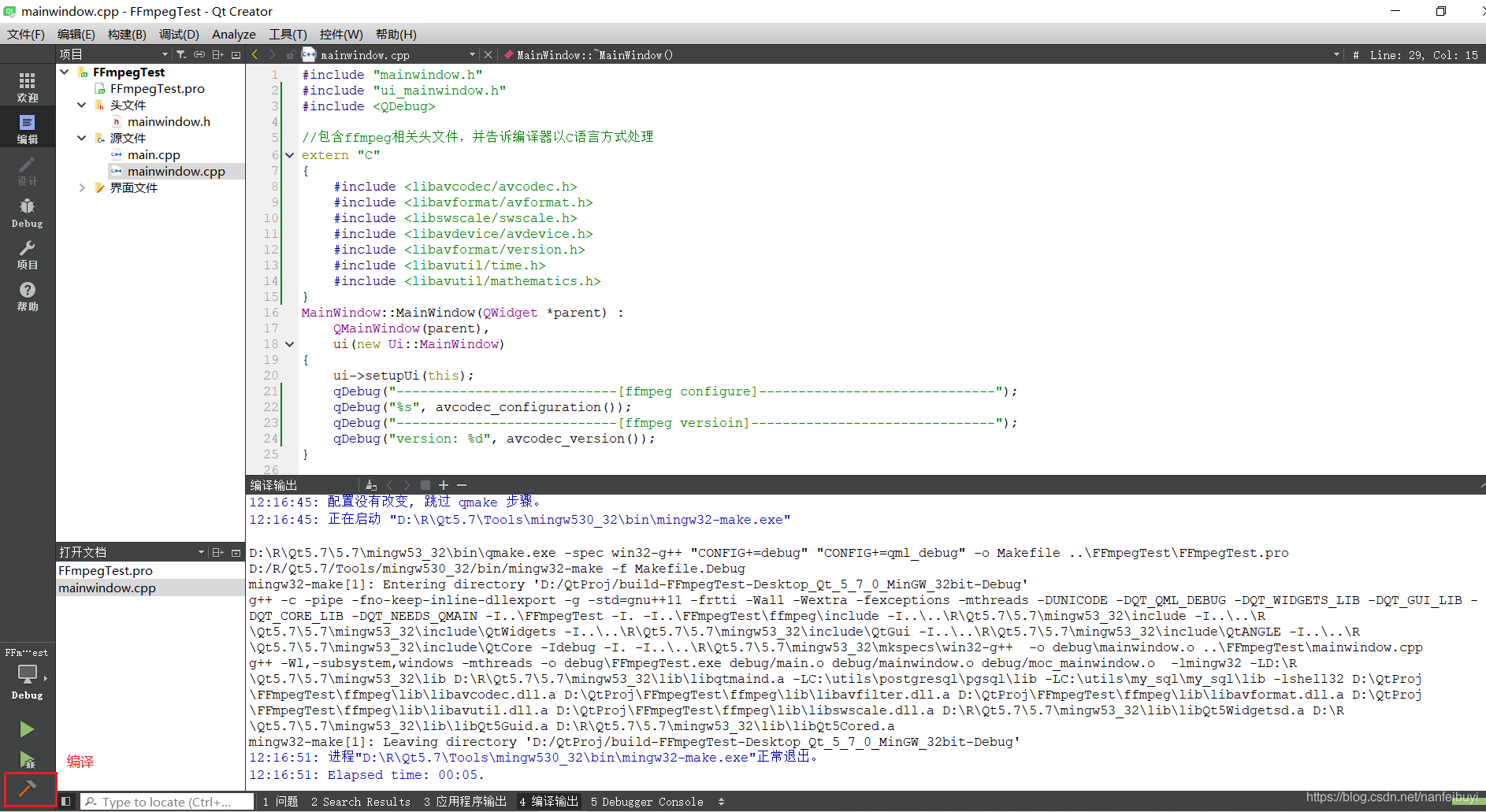

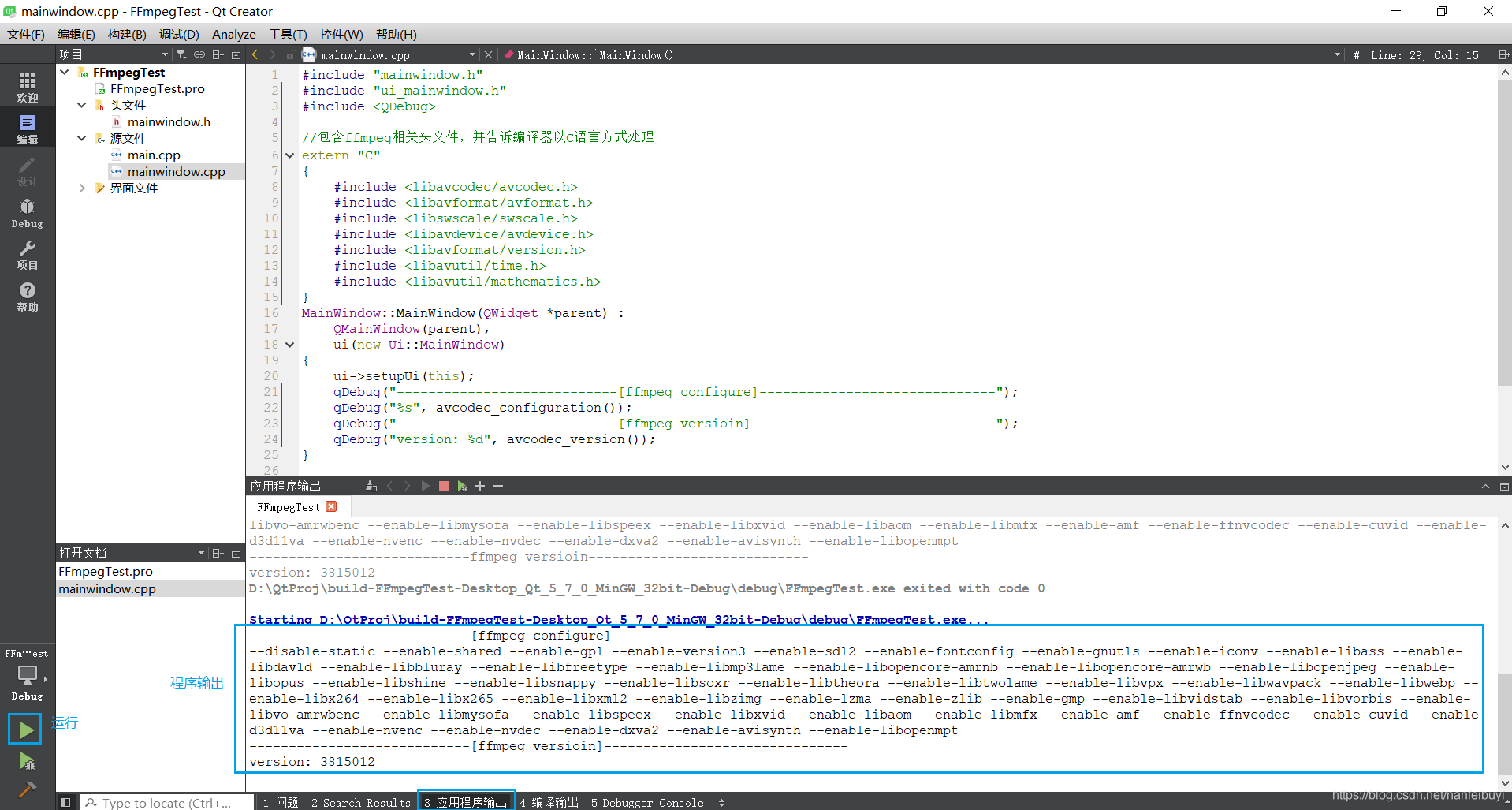

四、简单测试FFmpeg是否可用 (例子1)

4.1 编写代码输出FFmpeg的配置信息和版本信息

4.2 编译

4.3 运行

因为是动态编译,在运行前需要将程序所需要的动态库拷贝到程序的同级目录,或者是将动态库路径设置到环境变量。

例子是debug版本,就将动态库拷贝到debug目录

五、播放视频(例子2 )

主要代码:

#include "mainwindow.h"

#include "ui_mainwindow.h"

#include <QDebug>

#include <QTime>

#include <QIcon>

#include <QPixmap>

#include <QFileDialog>

#include <QMessageBox>

#include <QSlider>

#include <QComboBox>

//包含ffmpeg相关头文件,并告诉编译器以C语言方式处理

extern "C"

{

#include <libavcodec/avcodec.h>

#include <libavformat/avformat.h>

#include <libswscale/swscale.h>

#include <libavdevice/avdevice.h>

#include <libavformat/version.h>

#include <libavutil/time.h>

#include <libavutil/mathematics.h>

#include <libavutil/imgutils.h>

}

MainWindow::MainWindow(QWidget *parent) :

QMainWindow(parent),

ui(new Ui::MainWindow)

{

//输出FFmpeg版本信息

qDebug("ffmpeg versioin is: %u", avcodec_version());

ui->setupUi(this);

//初始化

init();

}

MainWindow::~MainWindow()

{

delete ui;

}

//初始化

void MainWindow::init()

{

mVideoWidth = this->width();

mVideoHeight = this->height();

//设置视频label的宽高为窗体宽高

ui->labelVideo->setGeometry(0, 0, mVideoWidth, mVideoHeight);

//初始化播放速度

mPlaySpdVal = PLAY_SPD_10;

//初播放状态wei

mVideoPlaySta = Video_PlayFinish;

/*****在状态栏添加一个用来显示视频路径的label************/

//用于显示已经选择的视频文件路径

mVideoFile = new QLabel(this);

mVideoFile->setToolTip("视频文件");

ui->statusBar->addWidget(mVideoFile);

/*****在工具栏添加选择动作************/

//创建一个选择视频文件动作

QAction* pActionSelectVideoFile = new QAction(QIcon(QPixmap(":/selectVideo.png")), "选择");

//设置鼠标悬停提示文本

pActionSelectVideoFile->setToolTip("选择视频文件");

//将动作添加到工具栏

ui->mainToolBar->addAction(pActionSelectVideoFile);

//连接动作的点击事件

QObject::connect(pActionSelectVideoFile, SIGNAL(triggered(bool)), this, SLOT(on_selectVideoFile()));

/*****在工具栏添加播放/暂停动作************/

//创建一个播放/暂停视频动作

mActionPlayCtrl = new QAction(QIcon(QPixmap(":/play.png")), "播放");

//设置鼠标悬停提示文本

mActionPlayCtrl->setToolTip("播放视频");

//将动作添加到工具栏

ui->mainToolBar->addAction(mActionPlayCtrl);

//连接动作的点击事件

QObject::connect(mActionPlayCtrl, SIGNAL(triggered(bool)), this, SLOT(on_videoPlayCtrl()));

/*****在工具栏添加停止动作************/

//创建一个停止播放视频动作

QAction* pActionStopPlay = new QAction(QIcon(QPixmap(":/stop.png")), "停止");

//设置鼠标悬停提示文本

pActionStopPlay->setToolTip("停止播放");

//将动作添加到工具栏

ui->mainToolBar->addAction(pActionStopPlay);

//连接动作的点击事件

QObject::connect(pActionStopPlay, SIGNAL(triggered(bool)), this, SLOT(on_stopPlayVideo()));

/*****在工具栏添加窗体大小适配视频宽高动作************/

//创建一个停止播放视频动作

QAction* pActionAutoSize = new QAction(QIcon(QPixmap(":/autoSize.png")), "自适应");

//设置鼠标悬停提示文本

pActionAutoSize->setToolTip("窗体自适应视频宽高");

//将动作添加到工具栏

ui->mainToolBar->addAction(pActionAutoSize);

//连接动作的点击事件

QObject::connect(pActionAutoSize, SIGNAL(triggered(bool)), this, SLOT(on_autoSize()));

//添加分隔符

ui->mainToolBar->addSeparator();

//添加播放速度下拉选择

QStringList plsySpdItems;

plsySpdItems << "0.5";

plsySpdItems << "0.8";

plsySpdItems << "1";

plsySpdItems << "1.2";

plsySpdItems << "1.5";

plsySpdItems << "2";

plsySpdItems << "3";

plsySpdItems << "4";

QComboBox* comboBoxPlaySpd = new QComboBox();

comboBoxPlaySpd->setToolTip("播放速度");

comboBoxPlaySpd->addItems(plsySpdItems);//添加倍速选项

comboBoxPlaySpd->setCurrentIndex(2);//设置默认速度1

comboBoxPlaySpd->setEditable(false);//设置为不可编辑

//设置样式

//comboBoxPlaySpd->setStyleSheet("QComboBox { border:1px solid black; min-width: 30px;} QComboBox QAbstractItemView::item {min-height:20px; background-color: rgb(0, 0, 0);} QFrame { border: 1px solid black; }");

ui->mainToolBar->addWidget(comboBoxPlaySpd);

QObject::connect(comboBoxPlaySpd, SIGNAL(currentIndexChanged(int)), this, SLOT(on_playSpdChange(int)));

//添加分隔符

ui->mainToolBar->addSeparator();

//添加播放声音滑动条到工具栏

QString sliderStyle = "QSlider::groove:horizontal{ \

height: 6px; \

background: qlineargradient(x1: 0, y1: 0, x2: 0, y2: , stop: 0 rgb(124, 124, 124), stop: 1.0 rgb(72, 71, 71)); \

} \

QSlider::handle:horizontal { \

width: 5px; \

background: rgb(0, 160, 230); \

margin: -6px 0px -6px 0px; \

border-radius: 9px; \

}";

QSlider* slider = new QSlider(Qt::Orientation::Horizontal, this);

slider->setToolTip("音量");

slider->setMaximumWidth(100);//设置最大值

slider->setRange(0, 100);//设置滑动范围

slider->setStyleSheet(sliderStyle);//设置样式

ui->mainToolBar->addWidget(slider);

//连接动作的滑动事件

QObject::connect(slider, SIGNAL(sliderMoved(int)), this, SLOT(on_VolumeChange(int)));

/*****在工具栏添加一个用来显示音量的label************/

mCurVolume = new QLabel("音量60");

mCurVolume->setToolTip("当前音量值");

ui->mainToolBar->addWidget(mCurVolume);

}

//延时, 不能直接sleep延时,UI主线程不能直接被阻塞,不然会有问题的

void delay(int ms)

{

QTime stopTime;

stopTime.start();

//qDebug()<<"start:"<<QTime::currentTime().toString("HH:mm:ss.zzz");

while(stopTime.elapsed() < ms)//stopTime.elapsed()返回从start开始到现在的毫秒数

{

QCoreApplication::processEvents();

}

//qDebug()<<"stop :"<<QTime::currentTime().toString("HH:mm:ss.zzz");

}

//重新设置窗体和视频Label的宽高

void MainWindow::resizeWindow(int width, int height)

{

if(width<1)

{

width = this->width();

}

if(height<1)

{

height = this->height();

}

this->setGeometry(100, 100, width, height);

ui->labelVideo->setGeometry(0, 0, width, height);

}

//窗体变化事件

void MainWindow::resizeEvent(QResizeEvent* event)

{

Q_UNUSED(event);

//让视频Label跟随窗体变化

ui->labelVideo->resize(this->size());

}

//使用FFmpeg播放视频

int MainWindow::playVideo(char* videoPath)

{

unsigned char* buf;

int isVideo = -1;

int ret, gotPicture;

unsigned int i, streamIndex = 0;

AVCodec *pCodec;

AVPacket *pAVpkt;

AVCodecContext *pAVctx;

AVFrame *pAVframe, *pAVframeRGB;

AVFormatContext* pFormatCtx;

struct SwsContext* pSwsCtx;

//创建AVFormatContext

pFormatCtx = avformat_alloc_context();

//初始化pFormatCtx

if (avformat_open_input(&pFormatCtx, videoPath, NULL, NULL) != 0)

{

qDebug("avformat_open_input err.");

return -1;

}

//获取音视频流数据信息

if (avformat_find_stream_info(pFormatCtx, NULL) < 0)

{

avformat_close_input(&pFormatCtx);

qDebug("avformat_find_stream_info err.");

return -2;

}

//找到视频流的索引

for (i = 0; i < pFormatCtx->nb_streams; i++)

{

if (pFormatCtx->streams[i]->codecpar->codec_type == AVMEDIA_TYPE_VIDEO)

{

streamIndex = i;

isVideo = 0;

break;

}

}

//没有视频流就退出

if (isVideo == -1)

{

avformat_close_input(&pFormatCtx);

qDebug("nb_streams err.");

return -3;

}

//获取视频流编码

pAVctx = avcodec_alloc_context3(NULL);;

//查找解码器

avcodec_parameters_to_context(pAVctx, pFormatCtx->streams[streamIndex]->codecpar);

pCodec = avcodec_find_decoder(pAVctx->codec_id);

if (pCodec == NULL)

{

avcodec_close(pAVctx);

avformat_close_input(&pFormatCtx);

qDebug("avcodec_find_decoder err.");

return -4;

}

//初始化pAVctx

if (avcodec_open2(pAVctx, pCodec, NULL) < 0)

{

avcodec_close(pAVctx);

avformat_close_input(&pFormatCtx);

qDebug("avcodec_open2 err.");

return -5;

}

//初始化pAVpkt

pAVpkt = (AVPacket *)av_malloc(sizeof(AVPacket));

//初始化数据帧空间

pAVframe = av_frame_alloc();

pAVframeRGB = av_frame_alloc();

//创建图像数据存储buf

//av_image_get_buffer_size一帧大小

buf = (unsigned char *)av_malloc(av_image_get_buffer_size(AV_PIX_FMT_RGB32, pAVctx->width, pAVctx->height, 1));

av_image_fill_arrays(pAVframeRGB->data, pAVframeRGB->linesize, buf, AV_PIX_FMT_RGB32, pAVctx->width, pAVctx->height, 1);

//根据视频宽高重新调整窗口大小 视频宽高 pAVctx->width, pAVctx->height

resizeWindow(pAVctx->width, pAVctx->height);

//初始化pSwsCtx

pSwsCtx = sws_getContext(pAVctx->width, pAVctx->height, pAVctx->pix_fmt, pAVctx->width, pAVctx->height, AV_PIX_FMT_RGB32, SWS_BICUBIC, NULL, NULL, NULL);

//循环读取视频数据

for(;;)

{

if(mVideoPlaySta == Video_Playing)//正在播放

{

if(av_read_frame(pFormatCtx, pAVpkt) >= 0)//读取一帧未解码的数据

{

//如果是视频数据

if (pAVpkt->stream_index == (int)streamIndex)

{

//解码一帧视频数据

ret = avcodec_decode_video2(pAVctx, pAVframe, &gotPicture, pAVpkt);

if(ret < 0)

{

qDebug("Decode Error.\n");

continue;

}

if(gotPicture)

{

sws_scale(pSwsCtx, (const unsigned char* const*)pAVframe->data, pAVframe->linesize, 0, pAVctx->height, pAVframeRGB->data, pAVframeRGB->linesize);

QImage img((uchar*)pAVframeRGB->data[0], pAVctx->width, pAVctx->height, QImage::Format_RGB32);

ui->labelVideo->setPixmap(QPixmap::fromImage(img));

delay(mPlaySpdVal);//播放延时

}

}

av_packet_unref(pAVpkt);

}

else

{

break;

}

}

else if(mVideoPlaySta == Video_PlayFinish)//播放结束

{

break;

}

else//暂停

{

delay(300);

}

}

//释放资源

sws_freeContext(pSwsCtx);

av_frame_free(&pAVframeRGB);

av_frame_free(&pAVframe);

avcodec_close(pAVctx);

avformat_close_input(&pFormatCtx);

mVideoPlaySta = Video_PlayFinish;

qDebug()<<"play finish!";

return 0;

}

//选择视频文件

void MainWindow::on_selectVideoFile()

{

QString path = QFileDialog::getOpenFileName(this,"选择视频文件","D:\\Test\\Video\\","WMV视频(*.wmv);;MP4视频(*.mp4);;AVI视频(*.avi)");

if(!path.isEmpty())

{

mVideoFile->setText(path);

on_videoPlayCtrl();

}

}

//视频播放/暂停控制

void MainWindow::on_videoPlayCtrl()

{

QString videoFilePath = mVideoFile->text();

if(videoFilePath.isEmpty())

{

return;

}

//判断文件是都存在(以防被删除了)

// QFileInfo fileInfo(videoFilePath);

// if(fileInfo.isFile())

// {

// QMessageBox::information(this, "提示", "找不到文件:"+videoFilePath);

// return;

// }

//播放和暂停切换

if(mActionPlayCtrl->text() == "播放")

{

mActionPlayCtrl->setText("暂停");

mActionPlayCtrl->setToolTip("暂停视频");

mActionPlayCtrl->setIcon(QIcon(QPixmap(":/pause.png")));

if(mVideoPlaySta == Video_PlayFinish)

{

mVideoPlaySta = Video_Playing;

playVideo(videoFilePath.toLocal8Bit().data());

on_stopPlayVideo();

}

else

{

mVideoPlaySta = Video_Playing;

}

}

else

{

mActionPlayCtrl->setText("播放");

mActionPlayCtrl->setToolTip("播放视频");

mActionPlayCtrl->setIcon(QIcon(QPixmap(":/play.png")));

if(mVideoPlaySta == Video_Playing)

{

mVideoPlaySta = Video_PlayPause;

}

}

}

//停止播放视频

void MainWindow::on_stopPlayVideo()

{

mVideoPlaySta = Video_PlayFinish;

mActionPlayCtrl->setText("播放");

mActionPlayCtrl->setToolTip("播放视频");

mActionPlayCtrl->setIcon(QIcon(QPixmap(":/play.png")));

}

//窗体自适应视频宽高

void MainWindow::on_autoSize()

{

resizeWindow(mVideoWidth, mVideoHeight);

}

//窗体关闭事件

void MainWindow::closeEvent(QCloseEvent* event)//窗体关闭事件

{

//没有在播放视频时直接退出

if(mVideoPlaySta != Video_PlayFinish)

{

if(QMessageBox::Yes == QMessageBox::information(this, "提示", "确认关闭?", QMessageBox::Yes, QMessageBox::No))

{

mVideoPlaySta = Video_PlayFinish;

//event->accept();

}

else

{

event->ignore();//忽略,不关闭

}

}

}

//播放音量变化

void MainWindow::on_VolumeChange(int volume)

{

mCurVolume->setText("音量"+QString::number(volume));

}

//播放速度变化

void MainWindow::on_playSpdChange(int spdVal)

{

switch(spdVal)

{

case 0://0.5

mPlaySpdVal = PLAY_SPD_05;

break;

case 1://0.8

mPlaySpdVal = PLAY_SPD_08;

break;

case 2://1

mPlaySpdVal = PLAY_SPD_10;

break;

case 3://1.2

mPlaySpdVal = PLAY_SPD_12;

break;

case 4://1.5

mPlaySpdVal = PLAY_SPD_15;

break;

case 5://2

mPlaySpdVal = PLAY_SPD_20;

break;

case 6://3

mPlaySpdVal = PLAY_SPD_30;

break;

case 7://4

mPlaySpdVal = PLAY_SPD_40;

break;

default:

break;

}

}